Code: https://github.com/GuoleiSun/MCIS_wsss

Motivation

本文研究仅从图像级标注的监督信息学习语义分割的问题。

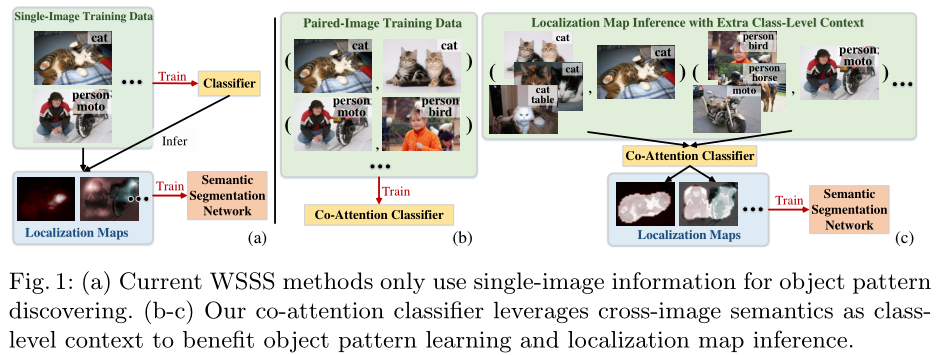

弱监督语义分割,即只给定图像级分类标注的语义分割。当前流行的方法是利用分类器的目标定位图(object localization maps)作为监督信号。

这类方法很难使得定位图( localization maps)捕获到更加完全的目标内容。

本文贡献

- 讨论了跨图像语义相关性对于完整对象模式学习以及对象位置推断的价值,通过在配对训练样本上共同注意力分类器的工作实现的。

- 本文的共同注意力分类器以更全面的方式挖掘语义线索。还通过共同注意力和对比注意力机制从跨图像间挖掘相似性和差异性进行互补监督。

- 本文方法在弱监督语义分割上泛化性很好,可以应用于Web上爬虫得到的图像数据。

Methods

不同于之前的方法,只关注单张图像的信息,本文提出的方法挖掘不同图像之间的信息。

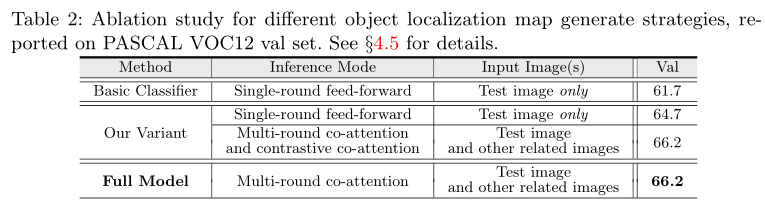

将注意力机制分为两种,co-attention和contrastive co-attention,前者从共同对象区域中学习相同的语义信息,后者注意在其他对象上,实现非共享的语义分类。

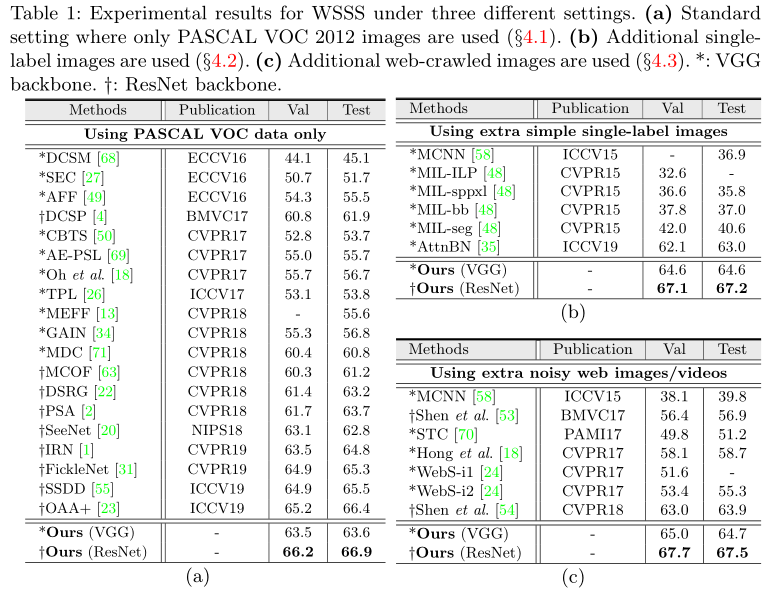

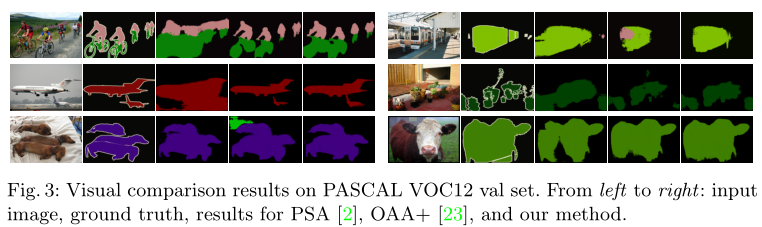

Experiments

本文方法在CVPR2020 LID workshop获得最佳论文,并在LID语义分割挑战赛道第一名。