Pdf: https://arxiv.org/abs/2009.06469

Abstract

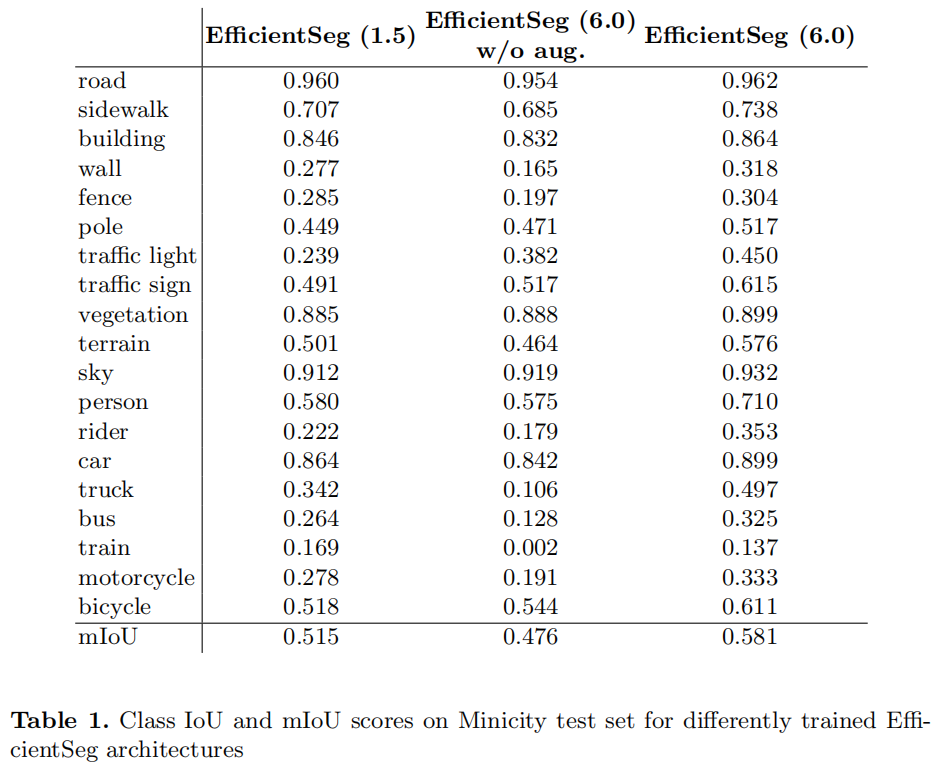

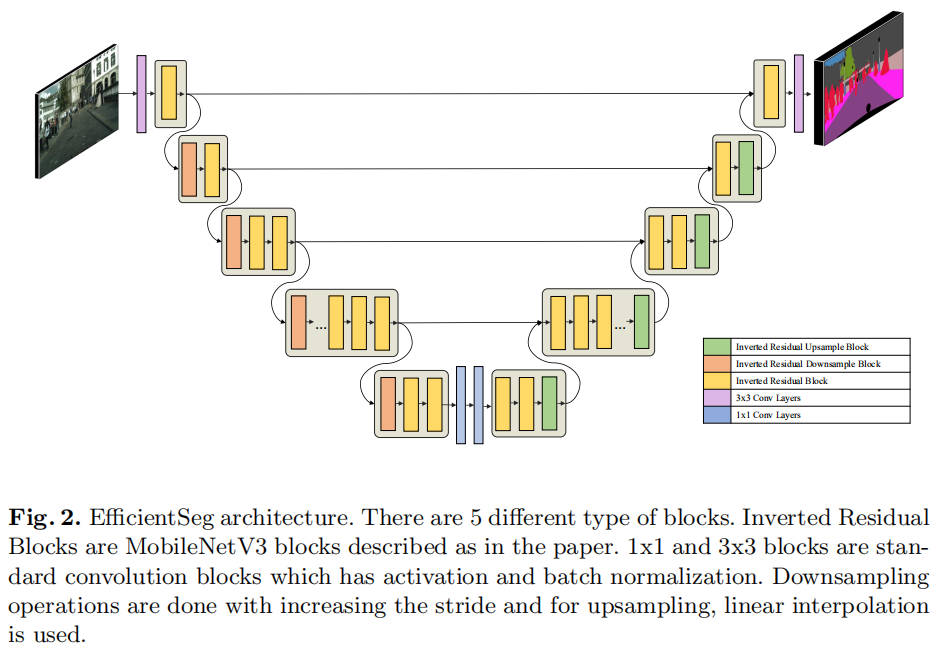

没有预先训练的权重和很少的数据的深度神经网络训练表明需要更多的训练迭代。 还已知的是,对于语义分割任务,较深层的模型比浅层模型更成功。 因此,我们介绍了EfficientSeg体系结构,它是U-Net的修改和可扩展版本,尽管其深度也可以有效地进行培训。 我们评估了Minicity数据集上的EfficientSeg体系结构,并使用相同的参数计数(51.5%mIoU)胜过了U-Net基线得分(40%mIoU)。 我们最成功的模型获得了58.1%的mIoU分数,并在ECCV 2020 VIPriors挑战的语义细分中排名第四。

Methods

Experiments